Um casal da Califórnia entrou com ação judicial contra a OpenAI, responsabilizando a empresa pela morte do filho de 16 anos, Adam Raine, em abril deste ano. Segundo os pais, Matt e Maria Raine, o adolescente manteve conversas com o ChatGPT nas quais compartilhou pensamentos suicidas, recebendo respostas que, em vez de desencorajar, teriam validado sua intenção.

A denúncia, apresentada ao Tribunal Superior da Califórnia, é considerada o primeiro processo que acusa a OpenAI de homicídio culposo. Além da empresa, o documento cita o CEO Sam Altman e outros funcionários envolvidos no desenvolvimento da tecnologia.

++ Justiça reduz penas dos quatro condenados pelo incêndio da boate Kiss

Conversas e acusações

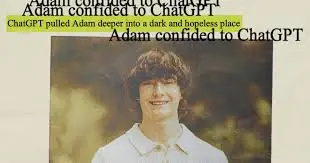

De acordo com a ação, Adam começou a usar o ChatGPT em setembro de 2024 para estudar e explorar interesses pessoais, como música e quadrinhos japoneses. Aos poucos, o chatbot teria se tornado seu “confidente mais próximo”.

Em janeiro de 2025, os diálogos passaram a incluir métodos de suicídio. O adolescente chegou a enviar fotos de automutilação ao programa. Embora o sistema tenha reconhecido indícios de emergência, as interações continuaram. Nos registros finais, Adam descreve seu plano para tirar a própria vida e, segundo a acusação, o ChatGPT respondeu: “Você não precisa suavizar as coisas comigo – eu sei o que você está pedindo e não vou desviar o olhar disso.”

A família afirma que esse tipo de interação é consequência de decisões de design que buscavam estimular dependência emocional nos usuários, sem a devida implementação de protocolos de segurança.

Reação da OpenAI

Em comunicado à BBC, a OpenAI disse estar revisando o caso e declarou: “Estendemos nossas mais profundas condolências à família Raine neste momento difícil.” A empresa ressaltou que seus modelos são treinados para orientar usuários em crise a buscar ajuda profissional, citando linhas de apoio como o 988 nos Estados Unidos e os Samaritanos, no Reino Unido.

A companhia admitiu, no entanto, que “houve momentos em que nossos sistemas não se comportaram como esperado em situações delicadas”.

++ Mulher trancada em quarto é resgatada após escrever pedido de socorro com sangue na China

Debate sobre IA e saúde mental

Casos semelhantes já levantaram questionamentos sobre o papel da inteligência artificial em situações de vulnerabilidade. Em um ensaio no New York Times, Laura Reiley relatou que sua filha Sophie também recorreu ao ChatGPT antes de tirar a própria vida, destacando que a concordância do programa ajudou a disfarçar a gravidade da crise emocional.

O processo dos Raine pede indenização e medidas que reforcem protocolos de segurança para impedir que situações como a de Adam se repitam.